相关推荐recommended

- 1418 - This function has none of DE

- SSM框架详细讲解

- Spring系列二:基于XML配置bean

- 【爬虫实战】用python爬豆瓣电影《热烈》的短评!

- IOC和AOP

- 2023 最新 Node.Js 语言实现 Electron.js 桌面

- SpringBoot简介

- Java+Swing+MySQL实现学生选课管理系统

- Nacos架构与原理深度分析

- 通用工资管理系统--SQL server课程设计(Java实现+SQL

- 手把手教你JAVA如何连接MYSQL-mysql-connector-

- springboot+mybatis+echarts +mysql制作

- Mybatis-Plus实现分页查询

- python教程lxml详解

- npm install webpack -g报错 rollbackFa

- python后端程序:Flask连接数据库mysql,实现基本SQL增

- 性能提升,SpringBoot 3.2虚拟线程来了

- springboot 配置不连接数据库启动

- Python项目分享(112个)计算机毕业设计 源码分享 实战 建议收

- 【ubuntu】 20.04 网络连接器图标不显示、有线未托管、设置界

- Nginx缓存配置

- SpringCloud Alibaba(一)微服务简介+Nacos的安

- Python Flask 封装ChatGPT流式输出接口

- SpringBoot+Redis完成数据缓存(内容丰富度一定超出你的想

- MS SQL Server 查看存储过程

- Docker从容器中项目如何访问到宿主机MYSQL

- Python爬虫——Python BS4解析库用法详解

- [golang 微服务] 7. go-micro框架介绍,go-mic

- 1 Nginx跨域配置

- 林子雨大数据技术原理与运用期末复习

用python写一个简单的爬虫

作者:mmseoamin日期:2023-12-11

爬虫是一种自动化程序,用于从互联网上获取数据。它能够模拟人类浏览网页的行为,访问网页并提取所需的信息。爬虫在很多领域都有广泛的应用,例如数据采集、信息监控、搜索引擎索引等。

下面是一个使用Python编写的简单爬虫示例:

import requests # 设置要爬取的网页链接 url = "https://example.com" # 发送请求,获取网页内容 response = requests.get(url) content = response.text # 打印网页内容 print(content)

在这个示例中,我们使用了requests库来发送GET请求并获取网页的内容。我们将目标网页的链接存储在url变量中,通过requests.get(url)发送请求并得到response响应对象。使用response.text可以获取网页的内容,最后通过print语句将网页内容打印出来。

请注意,在实际使用爬虫时,需要遵守相关网站的使用协议和法律法规,尊重网站的隐私政策和使用条款,避免对目标网站造成不必要的干扰或侵犯其合法权益。另外,为了提高爬虫的效率和稳定性,可能需要了解更多关于HTTP请求、网页解析和数据处理等方面的知识。

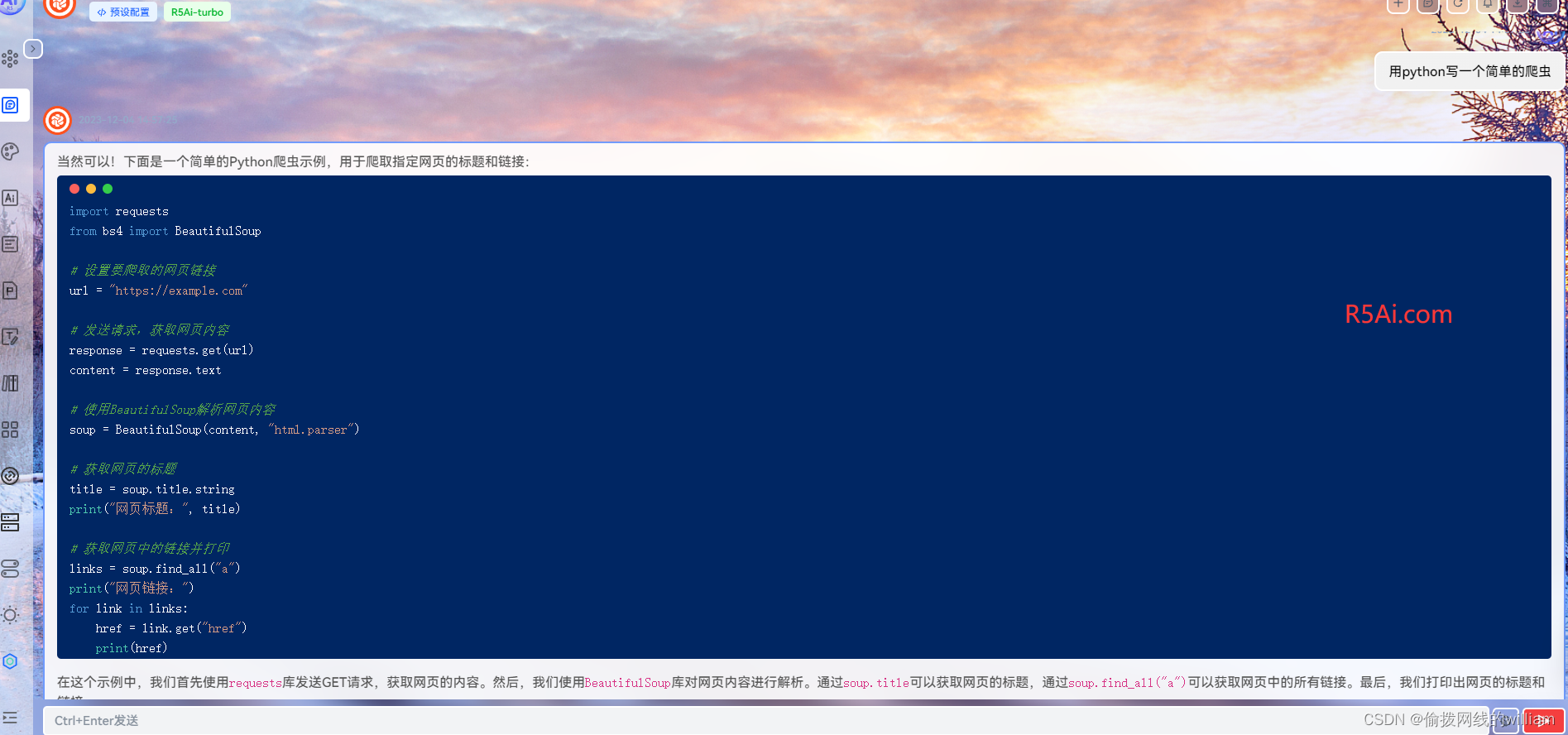

下面是一个简单的Python爬虫示例,用于爬取指定网页的标题和链接:

import requests

from bs4 import BeautifulSoup

# 设置要爬取的网页链接

url = "https://example.com"

# 发送请求,获取网页内容

response = requests.get(url)

content = response.text

# 使用BeautifulSoup解析网页内容

soup = BeautifulSoup(content, "html.parser")

# 获取网页的标题

title = soup.title.string

print("网页标题:", title)

# 获取网页中的链接并打印

links = soup.find_all("a")

print("网页链接:")

for link in links:

href = link.get("href")

print(href)

在这个示例中,我们首先使用requests库发送GET请求,获取网页的内容。然后,我们使用BeautifulSoup库对网页内容进行解析。通过soup.title可以获取网页的标题,通过soup.find_all(“a”)可以获取网页中的所有链接。最后,我们打印出网页的标题和链接。

请注意,爬取网页的行为需要遵守网站的使用规定和相关法律法规。在实际使用中,请确保您的爬虫行为合法,并且尊重网站的隐私政策和使用条款。